L’intelligence artificielle générative (IA) a connu un essor fulgurant ces dernières années, créant des bouleversements dans de nombreux secteurs. Les rédactions ne font pas exception.

Un nouveau rapport révèle que les publics et les journalistes sont préoccupés par la manière dont les organes de presse utilisent – et pourraient utiliser – l’IA générative telle que les chatbots, les générateurs d’images, d’audio ou de vidéo et des outils similaires.

Le rapport s’appuie sur trois années d’entretiens et de recherches en groupes de discussion sur l’IA générative et le journalisme en Australie et dans six autres pays (les États-Unis, le Royaume-Uni, la Norvège, la Suisse, l’Allemagne et la France).

Seuls 25 % des participants à notre enquête étaient convaincus d’avoir déjà rencontré l’IA générative dans le journalisme. Environ 50 % n’en étaient pas sûrs ou soupçonnaient l’avoir vu.

Cela suggère un manque potentiel de transparence de la part des médias lorsqu’ils utilisent l’IA générative. Cela pourrait également refléter un manque de confiance entre les médias et le public.

Qui ou quoi produit votre actualité – et de quelle manière – revêt une importance majeure pour de nombreuses raisons.

Certains médias ont tendance à utiliser plus ou moins de sources, par exemple, ou à utiliser certains types de sources – comme les hommes politiques ou les experts – plus que d’autres.

Certains médias sous-représentent ou déforment certaines parties de la communauté. Cela est parfois dû au fait que le personnel du média lui-même n'est pas représentatif de son public.

L’utilisation inconsidérée de l’IA pour produire ou éditer du journalisme peut reproduire certaines de ces inégalités.

Notre rapport recense des dizaines de façons dont les journalistes et les organes de presse peuvent exploiter l’IA générative. Il met également en lumière le niveau de confort du public face à chacune de ces approches.

Dans l’ensemble, les publics interrogés se sentent plus à l’aise avec l’utilisation de l’IA par les journalistes pour des tâches en coulisses plutôt que pour l’édition et la création. Il s’agit notamment d’utiliser l’IA pour retranscrire une interview ou pour fournir des idées sur la manière de traiter un sujet.

Mais ce ressenti dépend fortement du contexte. Le public était plutôt à l’aise avec certaines tâches d’édition et de création lorsque les risques perçus étaient plus faibles.

Le problème – et l’opportunité

L’IA générative peut être utilisée dans presque tous les domaines du journalisme.

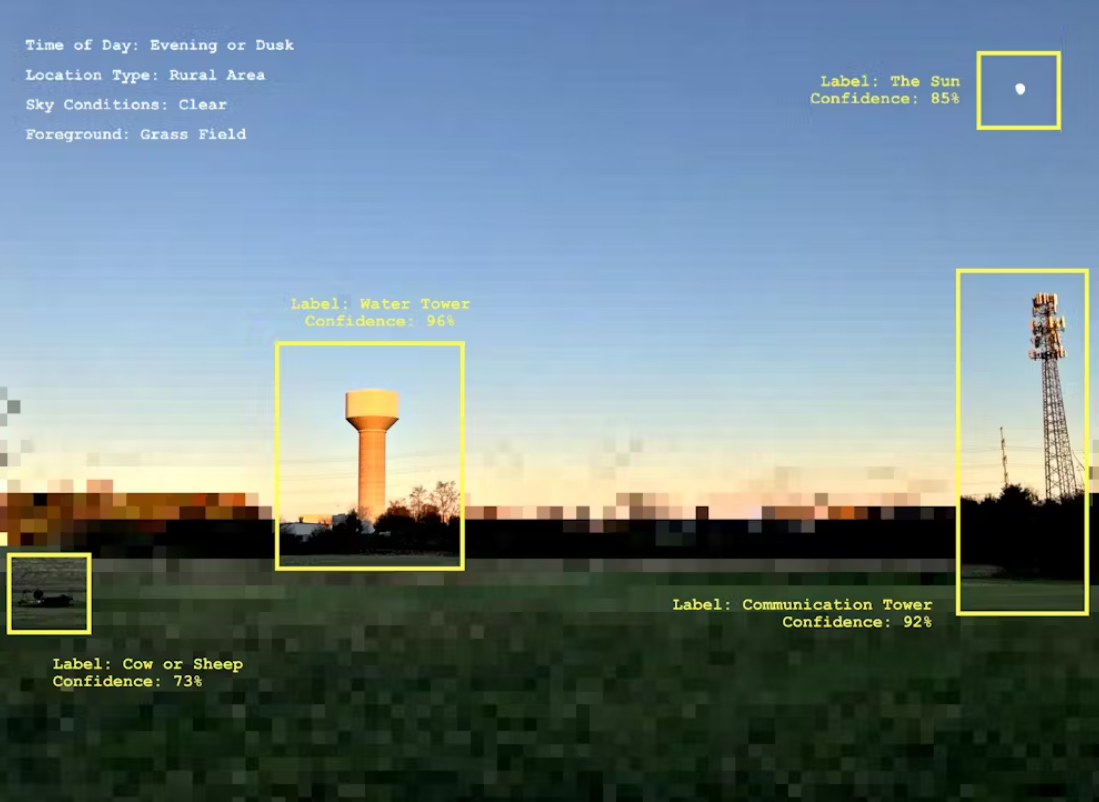

Par exemple, un photographe pourrait couvrir un événement. Ensuite, un outil d’IA générative pourrait sélectionner les images qu’il “pense” être les meilleures, les modifier pour les optimiser et ajouter des mots-clés à chacune d’elles.

Ces applications peuvent sembler relativement inoffensives. Mais que se passe-t-il si l’IA identifie quelque chose ou quelqu’un de manière incorrecte et que ces mots-clés conduisent à des identifications erronées dans les légendes des photos ? Et si les critères qui, selon les humains, définissent de “bonnes” images sont différents de ceux que pourrait considérer un ordinateur ? Ces critères peuvent également changer au fil du temps ou dans différents contextes.

Même une chose aussi simple que d’éclaircir ou d’assombrir une image peut provoquer un tollé d’un point de vue politique.

L’IA peut également inventer des choses de toutes pièces. Les images peuvent paraître photoréalistes mais montrer des choses qui ne se sont jamais produites. Les vidéos peuvent être entièrement générées par l’IA, ou éditées avec l’IA pour changer leur contexte.

L'IA générative est également fréquemment utilisée pour rédiger des titres ou résumer des articles. Ces applications semblent utiles pour les personnes qui manquent de temps, mais certains médias utilisent l'IA pour voler le contenu des autres.

Les alertes générées par l’IA peuvent également commettre des erreurs. Par exemple, Apple a récemment suspendu sa fonction de notification d’actualité générée automatiquement. Elle a pris cette mesure après que cette fonction ait faussement affirmé que Luigi Mangione, suspecté de meurtre aux États-Unis, s’était suicidé, la source étant attribuée à la BBC.

Que pensent les gens des journalistes qui utilisent l’IA ?

Nos recherches ont révélé que les publics semblent plus à l’aise avec le fait que les journalistes utilisent l’IA pour certaines tâches lorsqu’ils l’ont eux-mêmes utilisée à des fins similaires.

Par exemple, les personnes interrogées se sont montrées plutôt à l’aise avec l’idée que les journalistes utilisent l’IA pour flouter certaines parties d’une image. Nos participants ont déclaré utiliser des outils similaires sur des applications de visioconférence ou lorsqu’ils utilisaient le mode “portrait” sur leurs smartphones.

De même, lorsque vous insérez une image dans un logiciel de traitement de texte ou de présentation, celui-ci peut automatiquement créer une description écrite de l'image pour les personnes malvoyantes. Ceux qui avaient déjà rencontré de telles descriptions d'images par l'IA se sentaient plus à l'aise avec les journalistes qui utilisaient l'IA pour ajouter des mots-clés aux médias.

La manière la plus fréquente par laquelle nos participants ont été confrontés à l’IA générative dans le journalisme était lorsque les journalistes rapportaient du contenu d’IA devenu viral.

Par exemple, lorsqu'une image générée par l'IA prétendait montrer les princes William et Harry s'embrassant lors du couronnement du roi Charles, les médias ont rapporté cette fausse image.

Les publics participant à notre étude ont également vu des avis indiquant que l’IA avait été utilisée pour écrire, éditer ou traduire des articles de presse. Ils ont vu des images générées par l’IA accompagnant certains d’entre eux. Il s’agit d’une approche populaire au Daily Telegraph, qui utilise des images générées par l’IA pour illustrer bon nombre de ses chroniques d’opinion.

Dans l’ensemble, nos participants se sont sentis plus à l’aise avec les journalistes qui utilisaient l’IA pour le brainstorming ou pour enrichir des médias déjà créés. Viennent ensuite les journalistes qui utilisaient l’IA pour l’édition et la création. Mais le ressenti dépend fortement de l’utilisation spécifique.

La plupart de nos participants étaient à l’aise avec l’idée de recourir à l’IA pour créer des icônes pour une infographie. Mais ils étaient assez mal à l’aise avec l’idée d’un avatar IA pour présenter les informations, par exemple.

En ce qui concerne l’édition, la majorité de nos participants étaient à l’aise avec l’utilisation de l’IA pour animer des images historiques, comme celle-ci. L’IA peut être utilisée pour “animer” une image statique dans l’espoir d’attirer l’intérêt et l’engagement du public.

Votre rôle en tant que membre du public

Si vous n'êtes pas sûr que les journalistes utilisent l'IA ou comment ils le font, recherchez une directive ou une explication sur le sujet dans le média concerné. Si vous n'en trouvez pas, envisagez de demander au média d'élaborer et de publier une politique dédiée.

Envisagez de soutenir les médias qui utilisent l’IA pour compléter et soutenir – plutôt que remplacer – le travail humain.

Avant de prendre une décision, tenez compte de la fiabilité passée du journaliste ou du média en question et de ce que disent les preuves.

Photo de Mohamed Nohassi sur Unsplash.

Cet article a été initialement publié par The Conversation et republié sur IJNet avec autorisation.