¿Menos es más? Facebook anunció hace algunos días nuevos cambios en su feed de noticias. Los posts de amigos y familiares quedan dentro; el contenido de las Páginas (medios incluidos) queda fuera. Hay muchas preguntas acerca de qué significa esto para las publicaciones. También hay preguntas sobre lo que significa para la difusión de noticias falsas en la plataforma.

- "Si bien puede reducir la exposición accidental a información errónea, los cambios podrían, en algunos casos, solo endurecer las burbujas del filtro con un flujo constante de contenido de personas con ideologías similares. Entretanto, una reducción del feed de noticias a grupos y comunidades más amurallados podría exacerbar la exposición a información errónea" (Charlie Warzel, BuzzFeed).

- "El jefe de alianzas de noticias de Facebook, Campbell Brown, también dijo a algunas publicaciones importantes que los cambios harían que las personas vean menos contenido de 'medios, marcas y celebridades', pero que 'las historias compartidas entre amigos no se verán afectadas', lo que podría sugerir que las noticias falsas podrían distribuirse por encima del contenido de medios de comunicación legítimos" (Alex Kaplan, Media Matters).

- "Las cuentas que Facebook sugiere en la parte superior de su feed no pasarán necesariamente por ningún tipo de proceso de selección. Estas son malas noticias si tu radar de noticias falsas está un poco oxidado y tu tía es propensa a compartir enlaces de fuentes cuestionables" (Marissa Miller, Teen Vogue).

Facebook’s solution to Fake News is to publish less news unless your racist uncle shares news with you.

— Anthony De Rosa (@Anthony) January 12, 2018

Adam Mosseri, vicepresidente del News Feed de Facebook, intentó responder a estas preocupaciones en Twitter.

There are definitely risks, including more uncivil conversations, less informative stories. We just need to work on each.

— Adam Mosseri (@mosseri) January 14, 2018

Given that the vast majority of interactions between people are on friends’ stories, which are much less often problematic than the equivalent on page posts, it seems likely that this will create more good than bad.

— Adam Mosseri (@mosseri) January 14, 2018

Mientras tanto, The New York Times habló con algunas publicaciones de países donde Facebook ha estado experimentando con el feed "Explore", que desvía las noticias a una sección separada. Se trata de experimentos que no son idénticos a los que Facebook está probando con el News Feed de Estados Unidos, pero sí similares. En algunos de esos países, al menos, los editores informaron sobre "consecuencias involuntarias" a raíz de los cambios. Por ejemplo:

En Eslovaquia, donde los nacionalistas de derecha tomaron casi el 10% del Parlamento en 2016, los editores dijeron que los cambios habían ayudado a promover noticias falsas. Con los medios legítimos obligados a gastar dinero para colocarse en el News Feed, ahora compartir información depende de los usuarios.

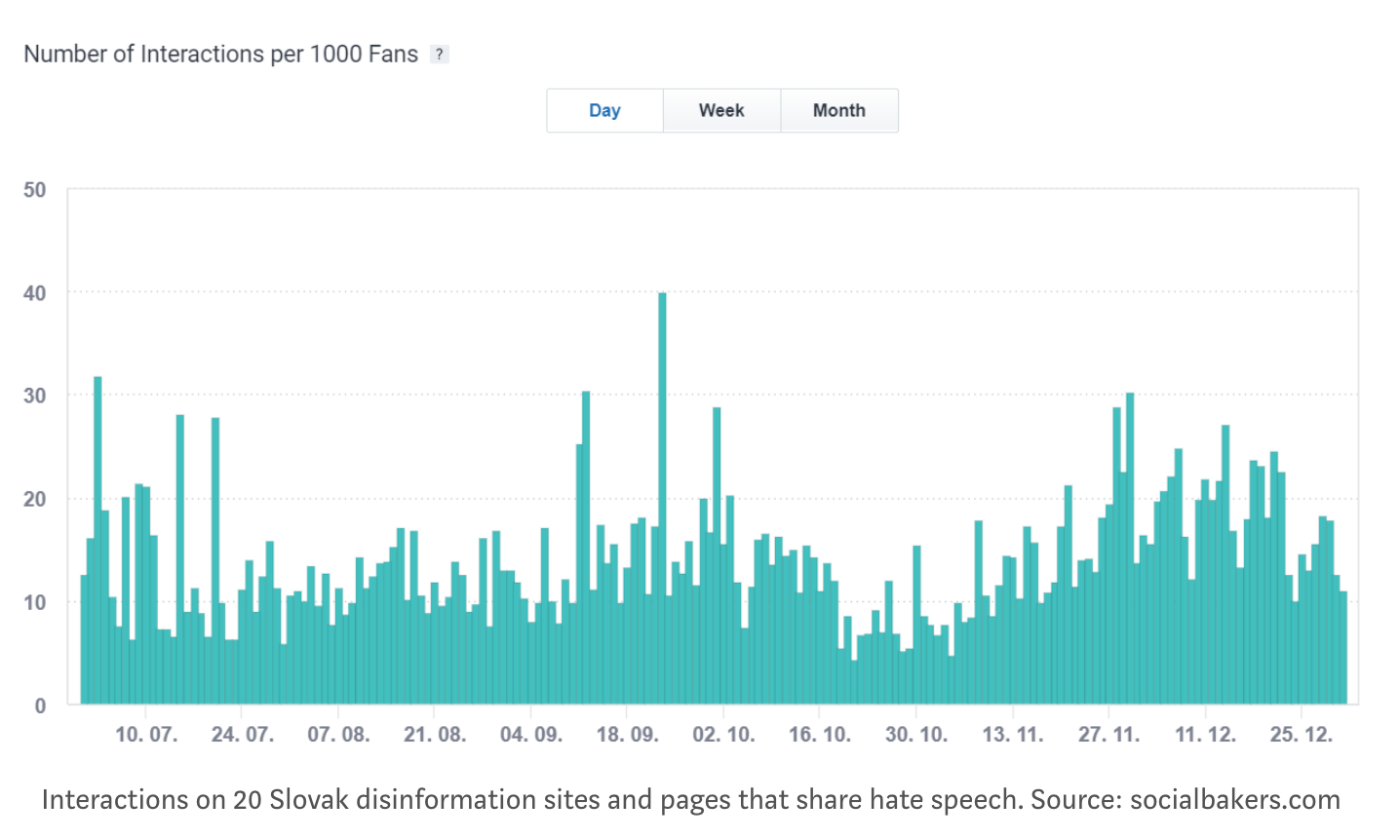

"La gente no suele compartir noticias aburridas con hechos aburridos", dijo Filip Struhárik, editor de redes sociales de Denník N, un sitio de noticias por suscripción eslovaco que vio una caída del 30% en el compromiso de Facebook después de los cambios. Struharik, que ha estado catalogando los efectos de Facebook Explore a través de un recuento mensual, ha notado un aumento constante en la participación de sitios que publican noticias falsas o sensacionalistas.

Y en Bolivia:

Bolivia también ha visto un aumento en las noticias falsas ya que los sitios de noticias legítimos quedaron escondidos detrás de la función Explore.

Durante las elecciones judiciales del mes de diciembre, un mensaje que se compartió ampliamente en Facebook y que decía provenir un funcionario electoral afirmaba que los votos serían válidos solo si se marcaba una X junto al nombre del candidato. Según otro post de ese día, los funcionarios del gobierno habían colocado bolígrafos con tinta borrable en las casillas de votación.

Es difícil cuantificar esto. En un post de Medium, Struhárik, el editor de redes sociales del medio eslovaco mencionado anteriormente, compartió un cuadro que sugiere que en su país "las interacciones en las páginas de noticias falsas no han disminuido desde que comenzó la prueba de Explore".

La prueba de Explore comenzó el 19 de octubre, que en la tabla puedes ver como el punto donde el tráfico se reduce en aproximadamente dos tercios. Pero los sitios de noticias falsas se recuperan rápidamente y terminan con un mayor compromiso que antes del cambio.

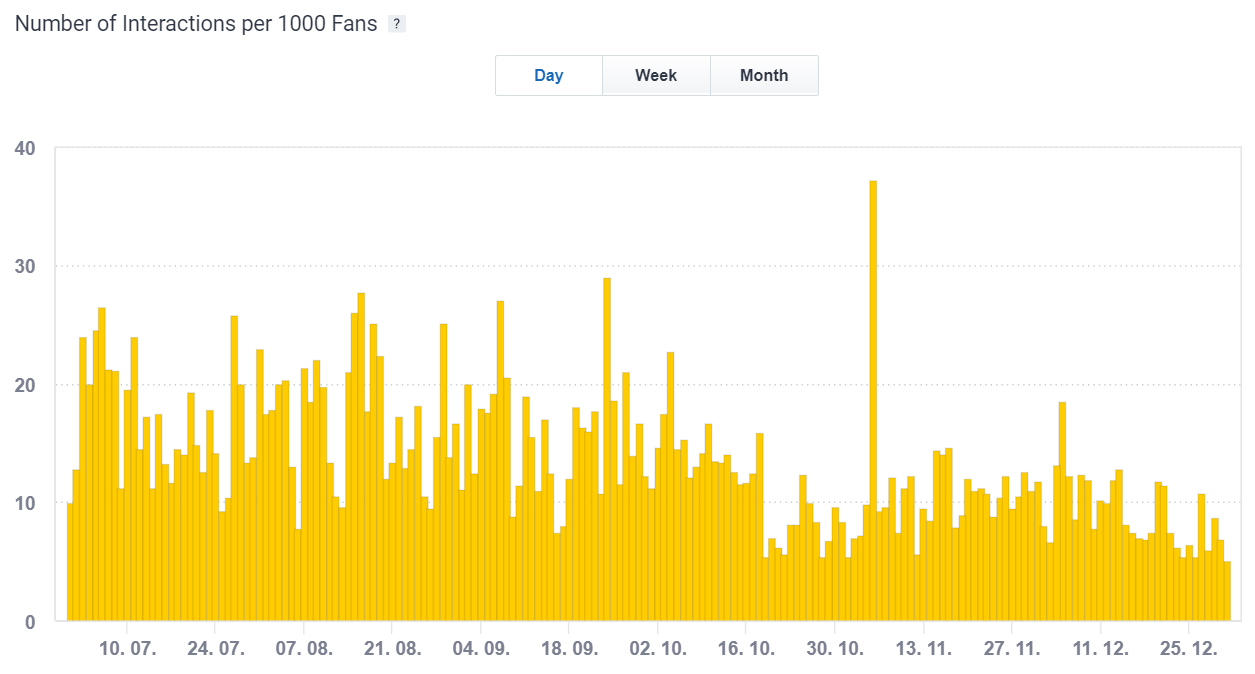

Compara esto con las interacciones de los principales sitios eslovacos durante el mismo período:

Sus interacciones disminuyeron al mismo tiempo, pero aún no se han recuperado.

— La Comisión Europea anuncia su panel de expertos en noticias falsas y desinformación online. Entre los 39 miembros están: Claire Wardle de First Draft, Rasmus Kleis Nielsen del Reuters Institute y Alexios Mantzarlis de la International Fact Checking Network/Poynter.

Nielsen está armando una "bibliografía abierta sobre investigaciones relevantes acerca de los problemas de desinformación", que puedes ver y a la que puedes contribuir aquí. Por ahora, la investigación más amplia proviene de los Estados Unidos y él no ha podido encontrar información sobre el alcance del problema en la Unión Europea: "¿Cuán extendido está el problema de las 'noticias falsas' en los Estados miembros de la UE? Simplemente no lo sabemos".

Can it really be true that there is not a single, publicly-available, evidence-based study measuring overall scale & scope of "fake news" in a EU country? The open bibliography on misinformation has grown to 10 pages already but no studies on reach/volume? https://t.co/yNnycrH8Ju

— Rasmus Kleis Nielsen (@rasmus_kleis) January 17, 2018

Much valuable research, and interesting case studies. But nothing akin to @andyguess et al “Selective Exposure to Misinformation: Evidence from the Consumption of Fake News during the 2016 US Campaign.” https://t.co/ohVzrm8rA6 or other attempts to measure overall reach+volume.

— Rasmus Kleis Nielsen (@rasmus_kleis) January 17, 2018

Este artículo fue publicado originalmente en Nieman Lab. Ha sido condensado y reproducido en IJNet con permiso.

Imagen con licencia Creative Commons en Flickr, vía The Public Domain Review.